Sistemas NVIDIA Blackwell Ultra , ya a la venta

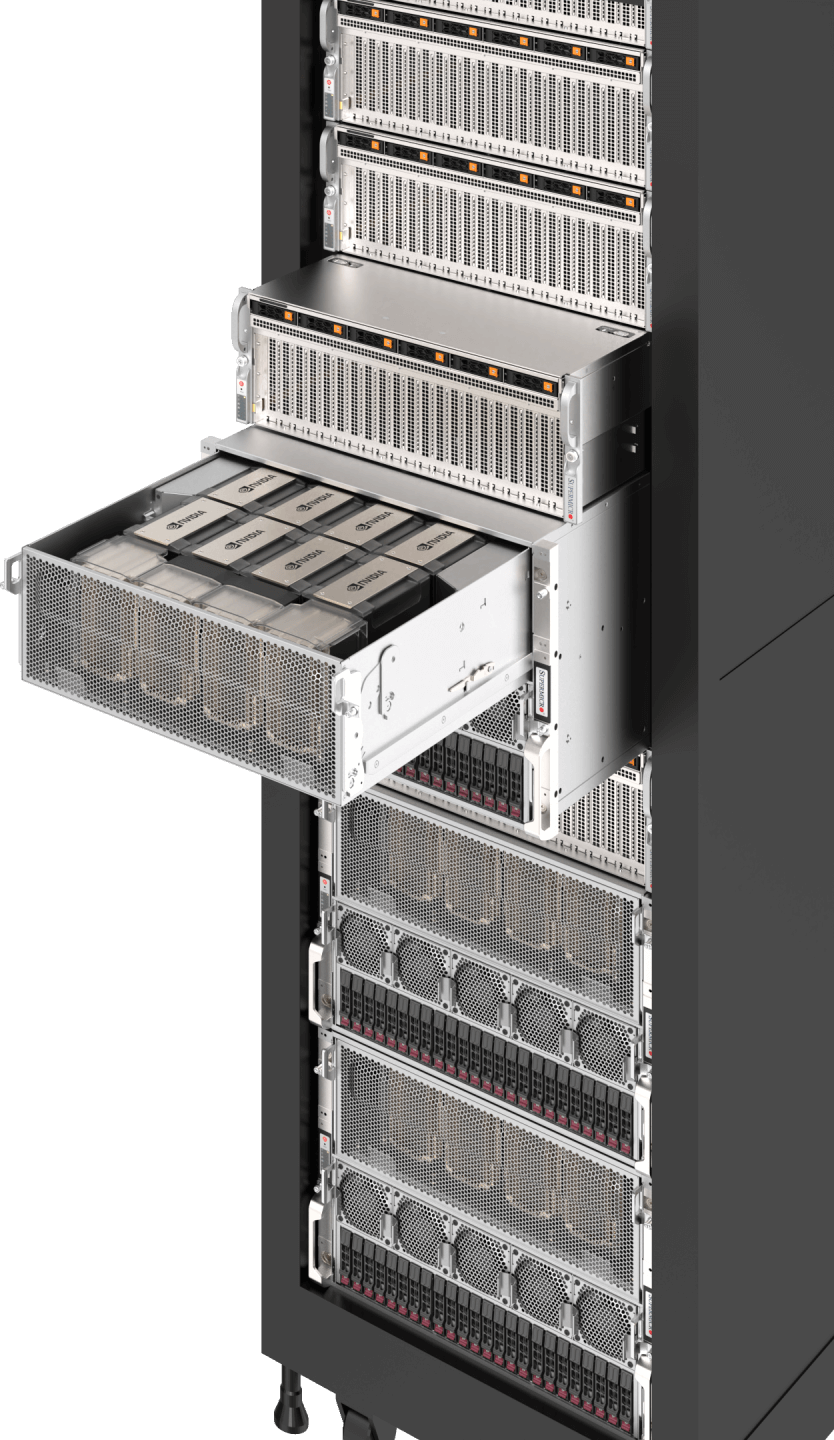

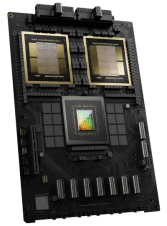

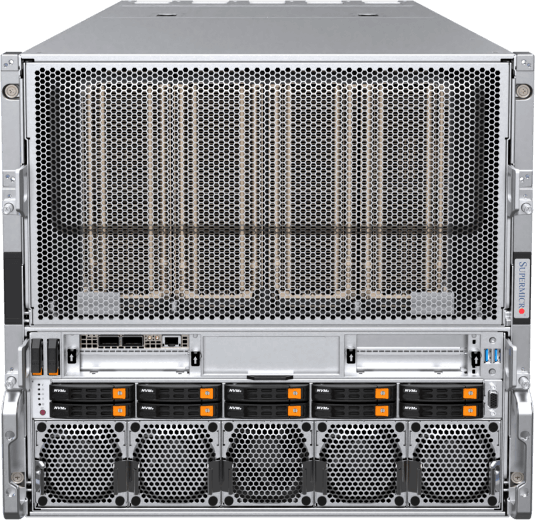

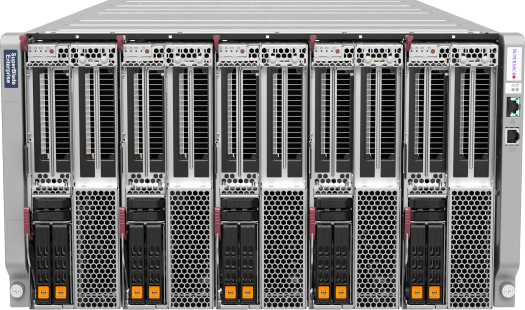

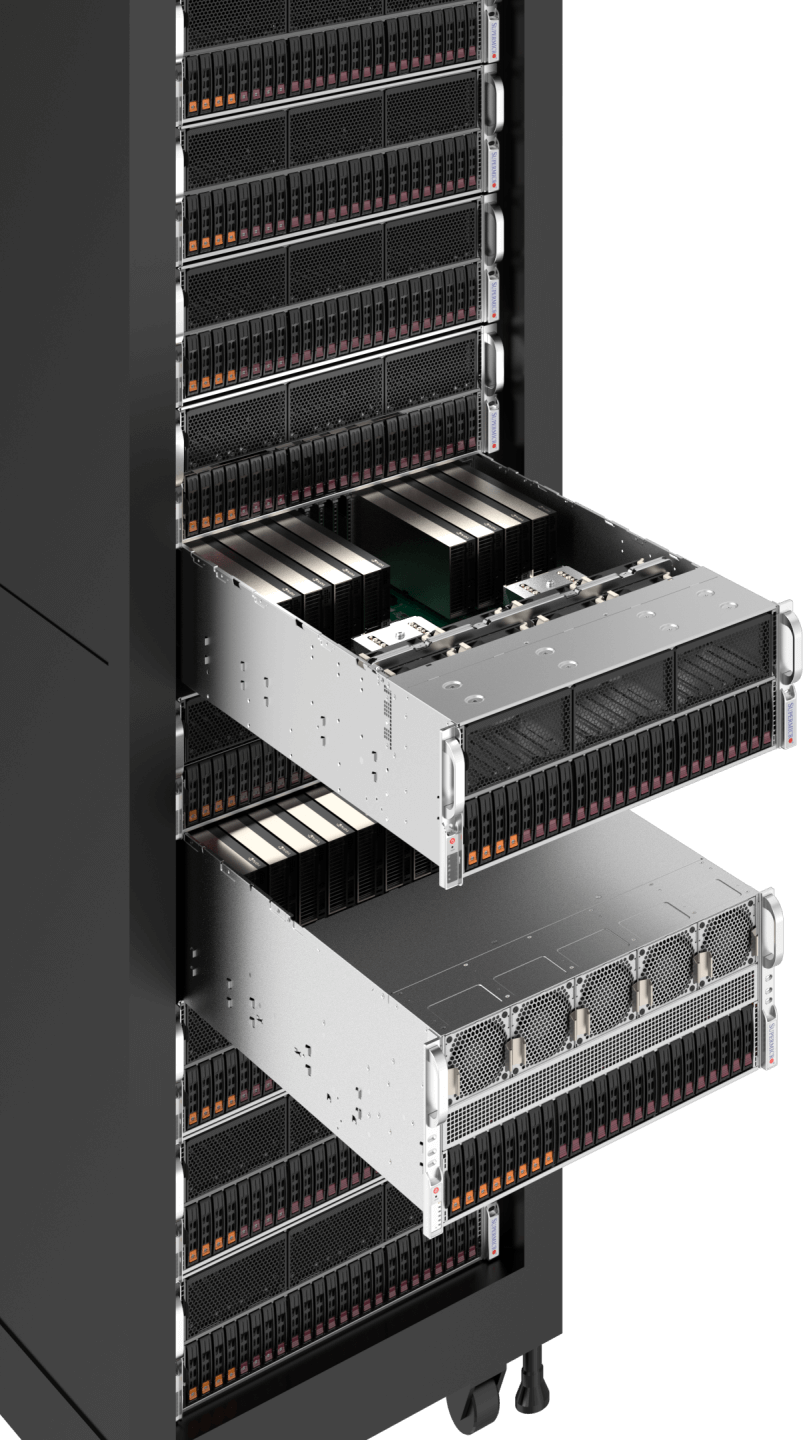

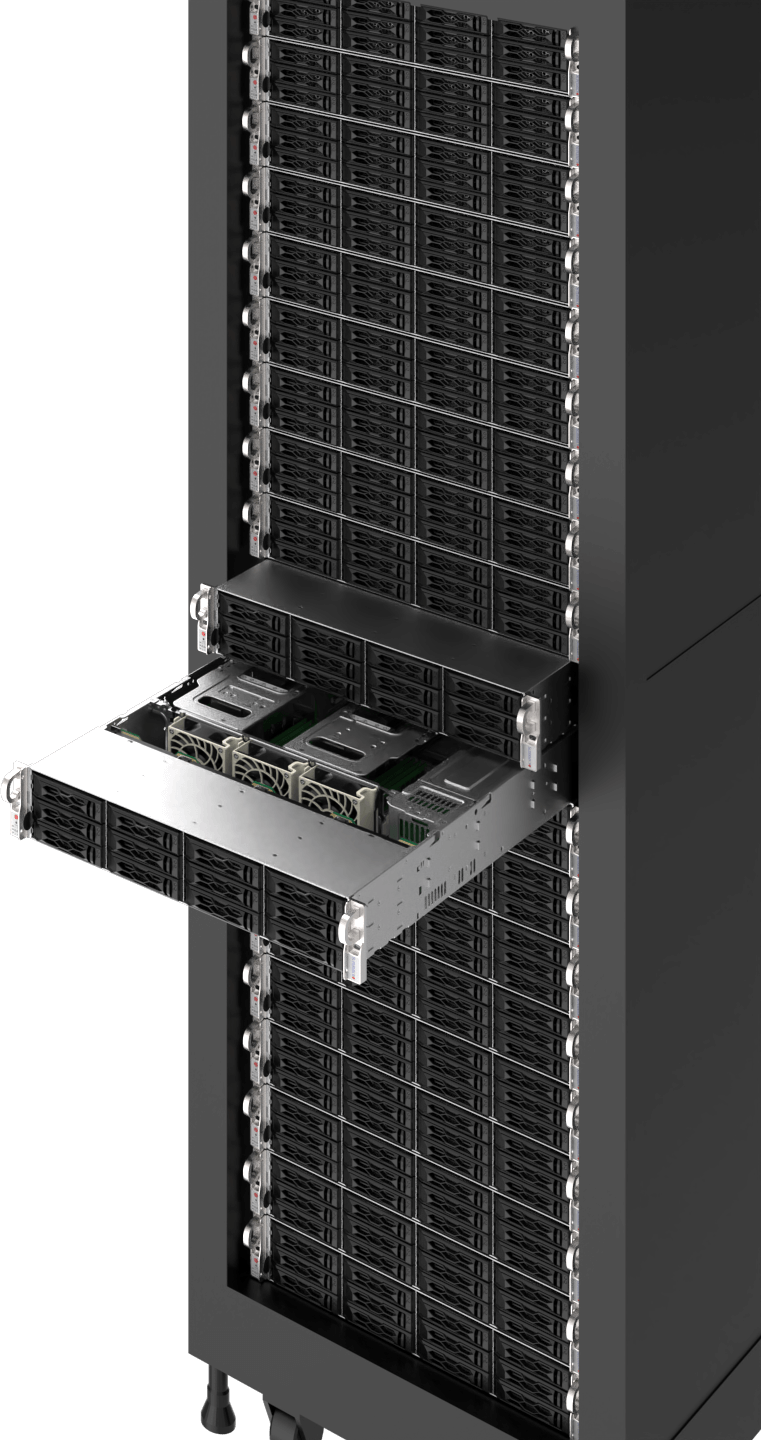

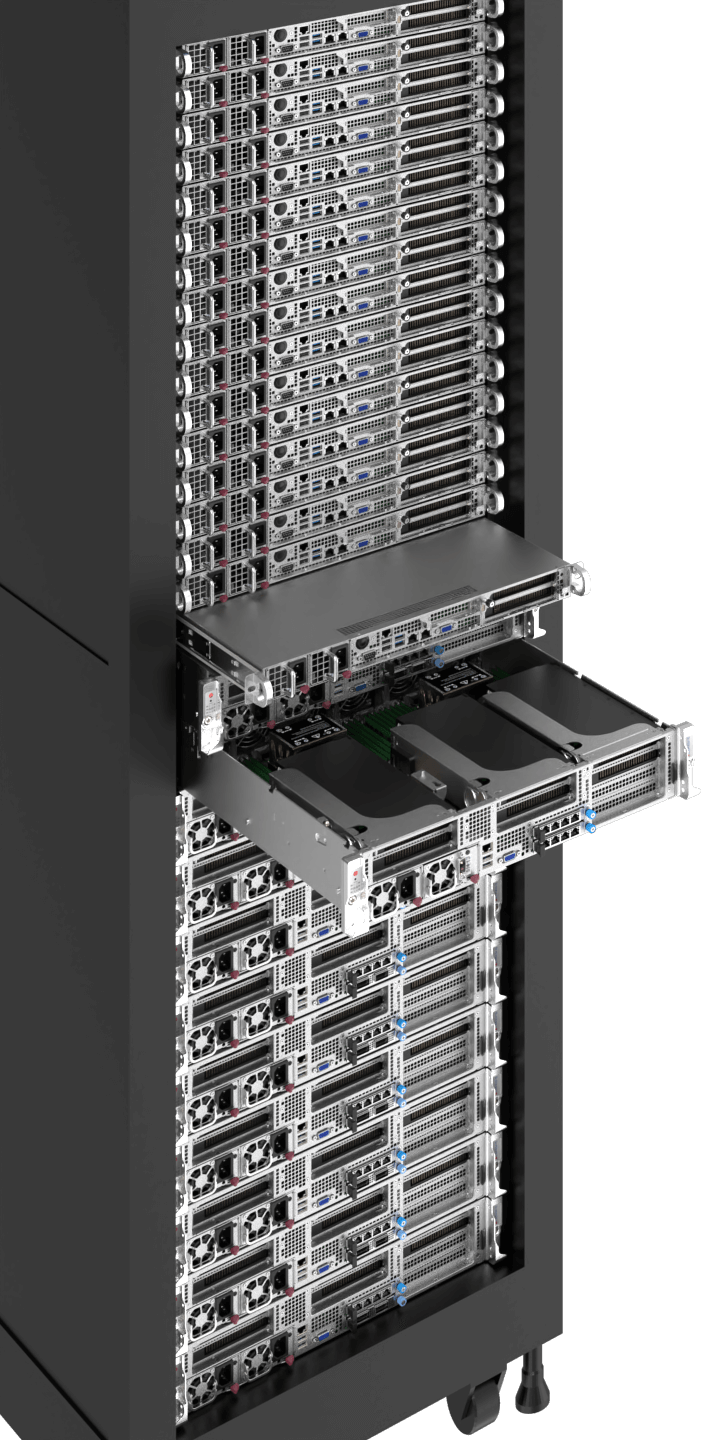

NVIDIA GB300 NVL72 SuperCluster

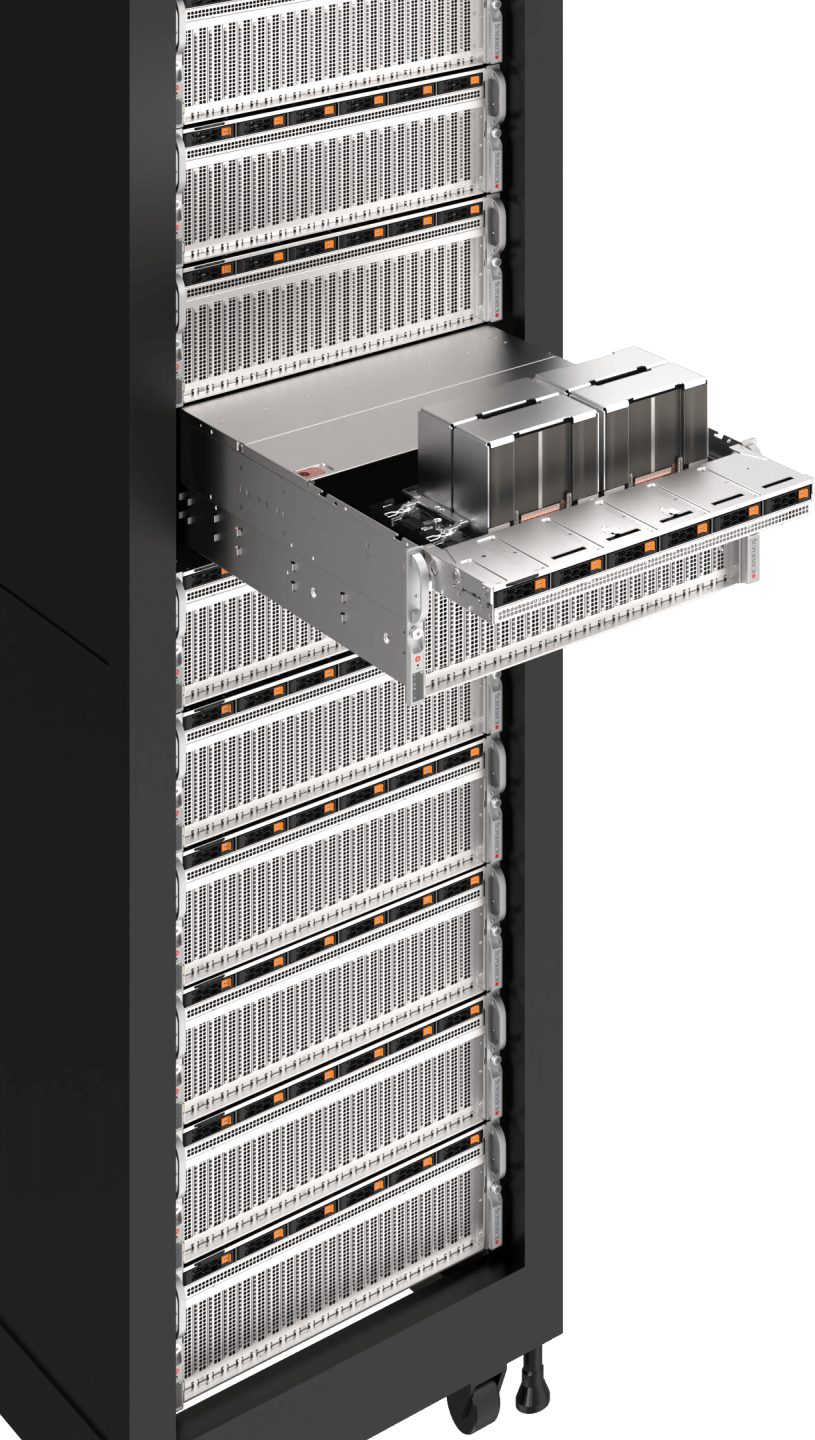

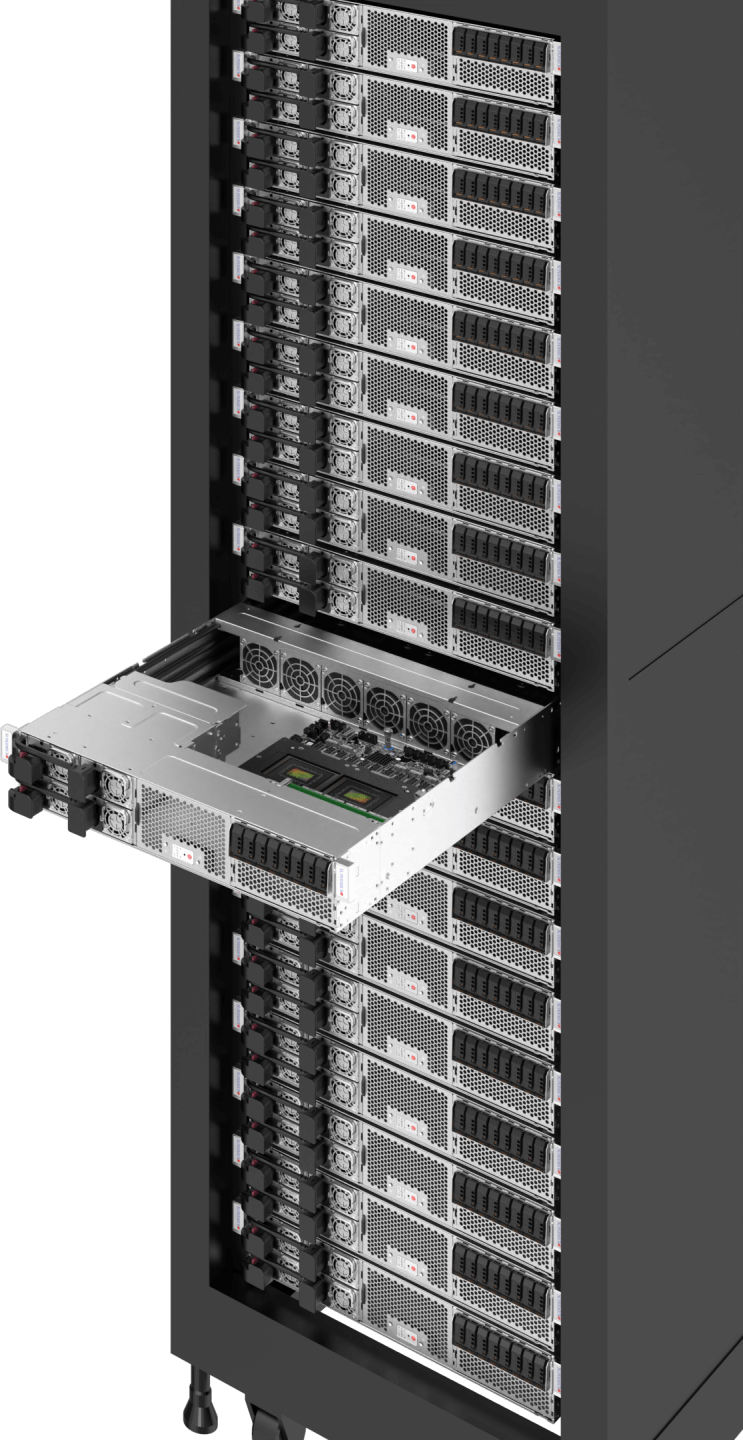

xAI Coloso

SuperClúster de IA Generativa

Desbloquee todo el potencial de la IA con las soluciones de infraestructura de vanguardia de Supermicro preparadas para IA. Desde el entrenamiento a gran escala hasta la inferencia inteligente en el borde, nuestros diseños de referencia llave en mano agilizan y aceleran la implementación de la IA. Potencie sus cargas de trabajo con un rendimiento y una escalabilidad óptimos al tiempo que optimiza los costes y minimiza el impacto medioambiental. Descubra un mundo de posibilidades con la diversa selección de soluciones optimizadas para cargas de trabajo de IA de Supermicro y acelere cada aspecto de su negocio.

Entrenamiento e inferencia de IA a gran escala

Grandes modelos lingüísticos, entrenamiento generativo de IA, conducción autónoma, robótica

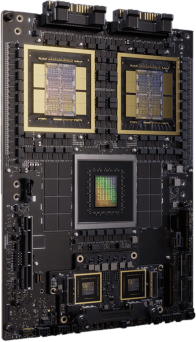

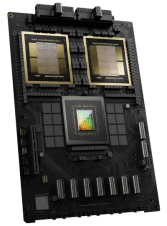

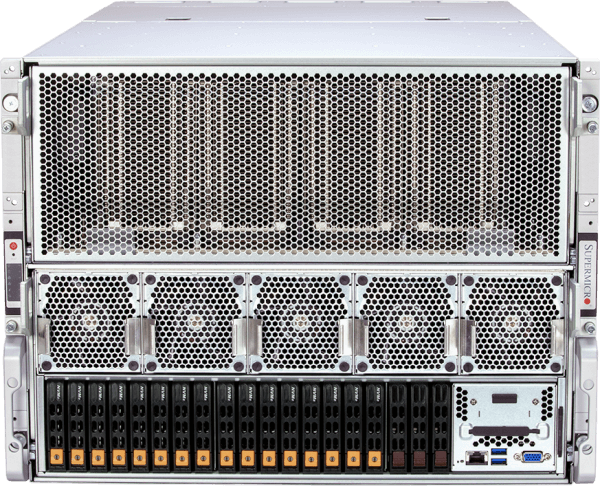

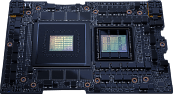

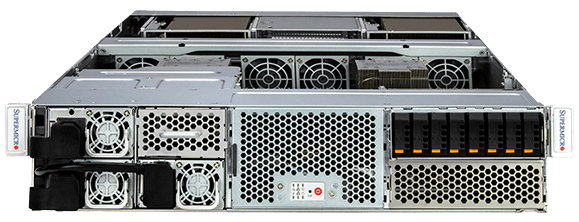

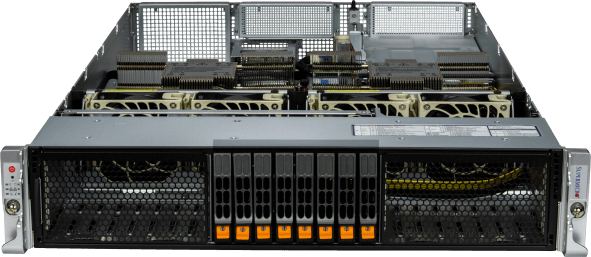

El entrenamiento de IA a gran escala exige tecnologías de vanguardia para maximizar la potencia de cálculo paralelo de las GPU, con el fin de gestionar miles de millones, si no billones, de parámetros de modelos de IA que deben entrenarse con conjuntos de datos masivos. Aprovechando las soluciones NVIDIA HGX™ B300/B200, GB300/GB200 NVL72 y las interconexiones GPU-GPU NVLink® y NVSwitch® más rápidas, con un ancho de banda de hasta 1,8 TB/s, así como la red 1:1 más rápida para cada GPU para la agrupación de nodos, estos sistemas están optimizados para entrenar grandes modelos de lenguaje desde cero y ponerlos a disposición de millones de usuarios simultáneos. Completando la pila con NVMe totalmente flash para un rápido flujo de datos de IA, Supermicro racks totalmente integrados con opciones de refrigeración líquida para garantizar una rápida implementación y una experiencia de entrenamiento de IA fluida.

Tamaños de carga de trabajo

- Extra grande

- Grande

- Mediana

- Almacenamiento

Sistemas y racks NVIDIA HGX B300/B200 refrigerados por líquido

NVIDIA GB300 NVL72 con refrigeración Supermicro

NVIDIA GB200 NVL72 con refrigeración líquida de Supermicro

Sistemas y racks NVIDIA HGX B300/B200 refrigerados por aire

Sistema 8U con NVIDIA HGX H200 de 8 GPU

Flash NVMe a escala de petabytes

Almacenamiento en disco duro a escala de petabytes

Recursos

HPC/AI

Simulación de ingeniería, investigación científica, secuenciación genómica, descubrimiento de fármacos

Cada vez son más las cargas de trabajo de HPC que aumentan los algoritmos de aprendizaje automático y la computación paralela acelerada por GPU para acelerar los descubrimientos de científicos, investigadores e ingenieros. Muchos de los clusters de supercomputación más rápidos del mundo ya aprovechan las ventajas de las GPU y el poder de la IA.

Las cargas de trabajo HPC suelen requerir simulaciones y análisis intensivos en datos con conjuntos de datos masivos y requisitos de precisión. Las GPU, como las H100/H200 de NVIDIA, ofrecen un rendimiento de doble precisión sin precedentes, entregando 60 teraflops por GPU, y las plataformas HPC altamente flexibles de Supermicro permiten un elevado número de GPU y CPU en una variedad de factores de forma densos con integración a escala de rack y refrigeración líquida.

Tamaños de carga de trabajo

- Grande

- Mediana

Sistema 8U/10 con NVIDIA HGX B200 de 8 GPU

NVIDIA GB200 NVL4

SuperBlade® de 6U/8U

3U/4U/5U, 8-10 GPU, PCIe

Sistema de tolva Grace 1U

Recursos

Inferencia y formación en IA empresarial

Inferencia generativa de IA, servicios/aplicaciones basados en IA, chatbots, sistemas de recomendación, automatización empresarial

El auge de la IA generativa ha sido reconocido como la próxima frontera para diversos sectores, desde la tecnología hasta la banca y los medios de comunicación. Ha comenzado la carrera por adoptar la IA como fuente para generar innovación, impulsar significativamente la productividad, agilizar las operaciones, tomar decisiones basadas en datos y mejorar la experiencia del cliente.

Tanto si se trata de aplicaciones y modelos de negocio asistidos por IA, como de chatbots inteligentes similares a los humanos para la atención al cliente, o de IA para copilotar la generación de código y la creación de contenidos, las empresas pueden aprovechar marcos abiertos, bibliotecas, modelos de IA preentrenados y perfeccionarlos para casos de uso únicos con su propio conjunto de datos. A medida que la empresa adopta la infraestructura de IA, la variedad de sistemas optimizados para GPU de Supermicro proporciona una arquitectura modular abierta, flexibilidad de proveedor y rutas de despliegue y actualización sencillas para tecnologías en rápida evolución.

Tamaños de carga de trabajo

- Extra grande

- Grande

- Mediana

3U/4U/5U, 8-10 GPU, PCIe

6U SuperBlade

Sistema MGX 2U

Sistema Grace MGX 2U

Recursos

Visualización y diseño

Colaboración en tiempo real, diseño 3D, desarrollo de juegos

La mayor fidelidad de los gráficos 3D y las aplicaciones habilitadas para IA por las GPU modernas está acelerando la digitalización industrial, transformando los procesos de desarrollo y diseño de productos, la fabricación y la creación de contenidos con simulaciones 3D fieles a la realidad para alcanzar nuevas cotas de calidad, iteraciones infinitas sin costes de oportunidad y plazos de comercialización más rápidos.

Construya infraestructura de producción virtual a escala para acelerar la digitalización industrial a través de las soluciones totalmente integradas de Supermicro, incluyendo los sistemas 4U/5U de 8-10 GPU, una arquitectura de referencia NVIDIA OVX™ optimizada para NVIDIA Omniverse Enterprise con conectores Universal Scene Description (USD), y servidores rack y estaciones de trabajo multi-GPU certificados por NVIDIA.

Tamaños de carga de trabajo

- Grande

- Mediana

4U/5U 8 GPU

Hyper 2U

Estaciones de trabajo AI

Estaciones de trabajo gráficas

Recursos

Entrega de contenidos y virtualización

Redes de distribución de contenidos (CDN), transcodificación, compresión, juegos en la nube y streaming

Las cargas de trabajo de distribución de vídeo siguen constituyendo una parte significativa del tráfico actual de Internet. A medida que los proveedores de servicios de streaming ofrecen cada vez más contenidos en 4K e incluso 8K, o juegos en la nube con una mayor frecuencia de actualización, la aceleración de la GPU con motores multimedia es imprescindible para multiplicar el rendimiento de los canales de streaming y reducir la cantidad de datos necesarios con una mayor fidelidad visual, gracias a las últimas tecnologías como la codificación y descodificación AV1.

Los sistemas multinodo y multi-GPU de Supermicro, como el sistema BigTwin® 2U de 4 nodos, cumplen los estrictos requisitos de la entrega de video moderna, con cada nodo compatible con la GPU NVIDIA L4 y la capacidad de ofrecer abundante almacenamiento PCIe Gen5 y velocidad de redes para impulsar el exigente pipeline de datos de las redes de entrega de contenido.

Tamaños de carga de trabajo

- Grande

- Mediana

- Pequeño

BigTwin® 2U de 4 nodos

2U UP CloudDC

2U DP Hyper

Recursos

Inteligencia Artificial

Transcodificación de vídeo Edge, inferencia Edge, formación Edge

En todos los sectores, las empresas cuyos empleados y clientes trabajan en ubicaciones periféricas (ciudades, fábricas, tiendas, hospitales, etc.) están invirtiendo cada vez más en la implementación de la IA en el perímetro. Al procesar los datos y utilizar algoritmos de IA y ML en el perímetro, las empresas superan las limitaciones de ancho de banda y latencia, lo que permite el análisis en tiempo real para la toma de decisiones oportuna, la atención predictiva y los servicios personalizados, así como la optimización de las operaciones empresariales.

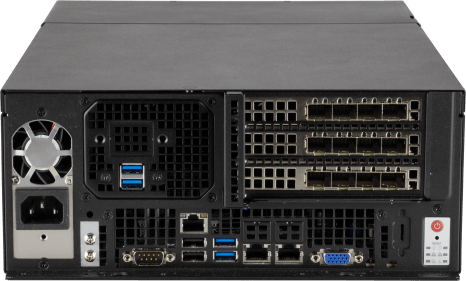

Los servidores Supermicro Edge AI, creados específicamente y optimizados para el entorno, con varios factores de forma compactos, ofrecen el rendimiento necesario para una baja latencia, arquitectura abierta con componentes preintegrados, compatibilidad con diversas pilas de hardware y software, y conjuntos de características de privacidad y seguridad necesarios para despliegues edge complejos listos para usar.

Tamaños de carga de trabajo

- Extra grande

- Grande

- Mediana

- Pequeño

Hyper

Compacto

Servidor Edge Multi-GPU de corta profundidad

Sin ventilador

Recursos

SuperClúster de IA Generativa

La cartera más amplia de sistemas preparados para la IA

Implante NVIDIA Omniverse™ a escala

Discurso del Director General de COMPUTEX 2024