Supermicro presenta sus nuevos sistemas de IA y aprendizaje automático de escala ampliada basados en GPU y NVIDIA Tesla

TAIPÉI, Taiwán, 30 de mayo de 2018 /PRNewswire/ -- Super Micro Computer, Inc. (NASDAQ: SMCI), un líder mundial en soluciones de computación, almacenamiento y redes para empresas, así como en la computación verde, ha anunciado la exposición de la más amplia selección del sector de plataformas de servidores de GPU compatibles con aceleradores PCI-E con núcleo Tensor para las unidades de procesamiento gráfico NVIDIA® Tesla® V100 y V100 SXM2 en su estand como patrocinador Platinum de la GPU Technology Conference (GTC) Taiwan 2018, que se celebra en el Taipei Marriott Hotel del 30 al 31 de mayo.

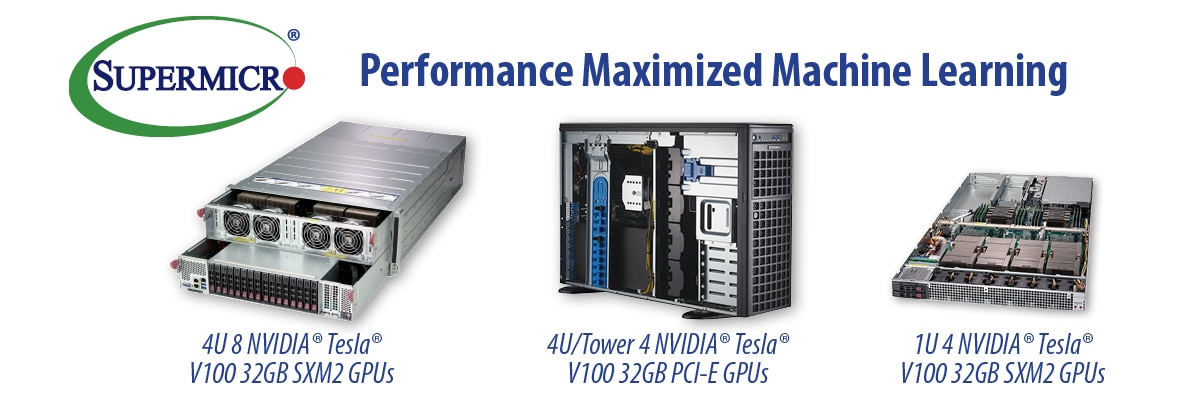

Los nuevos sistemas en 4U de Supermicro con la nueva generación de tecnología de interconexión NVIDIA NVLink™, optimizados para un rendimiento máximo, proporcionan la máxima aceleración para aplicaciones paralelas de elevado rendimiento como las de inteligencia artificial (IA), aprendizaje profundo, vehículos autónomos, ciudades inteligentes, sistemas de atención sanitaria, datos masivos, computación de alto rendimiento (HPC), realidad virtual y más. El SuperServer 4029GP-TVRT, que forma parte de las plataformas de servidor de GPU acelerado de clase NVIDIA HGX-T1, admite ocho aceleradores de GPU NVIDIA Tesla V100 SXM2 de 32 GB, proporciona el mayor ancho de banda posible de GPU a GPU para clústeres y aplicaciones a hiperescala. Al incorporar la última tecnología NVIDIA NVLink con un ancho de banda que supera cinco veces el que ofrecen las conexiones PCI-E 3.0, este sistema presenta una GPU independiente y una CPU con diseño térmico por zonas, lo que proporciona un rendimiento sin fallos y estabilidad incluso al procesar las cargas de trabajo más exigentes.

"En las pruebas comparativas hechas inicialmente, nuestro sistema 4029GP-TVRT fue capaz de alcanzar las 5.188 imágenes por segundo en cargas de trabajo ResNet-50 y 3.709 imágenes por segundo en cargas de trabajo InceptionV3", dijo Charles Liang, presidente y consejero delegado de Supermicro. "También nos parecen impresionantes los incrementos de rendimiento casi lineales cuando se amplía a múltiples sistemas usando la unidad GPU Direct RDMA. Con nuestras más recientes innovaciones, en las que se incorporan los nuevos aceleradores PCI-E para las GPU NVIDIA V100 de 32 GB y V100 SXM2 de 32GB con el doble de memoria en sistemas en 1U y 4U de rendimiento optimizado con NVLink de próxima generación, nuestros clientes son capaces de acelerar sus aplicaciones e innovaciones para ayudar a resolver algunos de los retos más complejos y desafiantes del mundo".

"Los clientes empresariales podrán aprovechar un nuevo nivel de eficiencia de computación gracias a la elevada densidad de los servidores de Supermicro, optimizados para unidades de procesamiento gráfico NVIDIA Tesla V100 de 32 GB con procesadores Tensor destinadas a centros de datos", afirmó Ian Buck, vicepresidente y director general de Computación Acelerada de NVIDIA. "La GPU V100 con el doble de memoria genera unos resultados un 50 por ciento más rápidos en complejas aplicaciones científicas y de aprendizaje profundo, además de mejorar la productividad de los desarrolladores al reducir la necesidad de optimización de memoria".

Los sistemas de GPU de Supermicro también son compatibles con los ultraeficientes Tesla P4 diseñados para acelerar la inferencia de cargas de trabajo en cualquier servidor de escala ampliada. El motor de transcodificación acelerada de hardware en el sistema Tesla P4 puede operar con 35 secuencias de vídeo HD en tiempo real y permite la integración del aprendizaje profundo en el canal de transcodificación de vídeo para permitir otro tipo de aplicaciones de vídeo inteligentes. A medida que el aprendizaje profundo da forma a nuestro mundo como ningún otro modelo de computación hasta la fecha, se entrenan más y más extensas redes neuronales complejas mediante el uso de volúmenes de datos exponencialmente mayores. Para conseguir la capacidad de respuesta deseada, estos modelos se implementan sobre los potentes servidores de GPU de Supermicro con los que proporcionar los mayores resultados para inferencia de cargas de trabajo.

Asimismo, Supermicro sigue haciendo gala de las plataformas de servidor de GPU acelerado de clase NVIDIA SCX-E3, como el sistema SuperServer 4029GR-TRT2 en 4U con rendimiento optimizado admite hasta 10 aceleradores PCI-E para las unidades de procesamiento gráfico NVIDIA Tesla V100 dentro del complejo e innovador diseño de PCI de raíz única optimizado para GPU de Supermicro, el cual mejora de manera exponencial el rendimiento de comunicación de GPU de punto a punto. Para conseguir una mayor densidad, los sistemas SuperServer 1029GQ-TRT admiten hasta cuatro aceleradores PCI-E para la GPU Tesla V100 en una configuración de rack en 1U y el nuevo SuperServer 1029GQ-TVRT que admite cuatro aceleradores de GPU para las unidades NVIDIA Tesla V100 SXM2 de 32 GB en 1U. Ambos servidores 1029GQ forman parte de la case NVIDIA SCX-E2 de plataformas de servidor de GPU acelerado.

Con la convergencia de las analíticas de datos masivos y el aprendizaje profundo, las más recientes arquitecturas de GPU NVIDIA y unos algoritmos mejorados de aprendizaje automático, las aplicaciones de aprendizaje profundo requieren la potencia de procesamiento de diferentes GPU que deben ser capaces de comunicarse de manera eficiente y eficaz para poder ampliar la red de GPU. El sistema de GPU NVIDIA de raíz única de Supermicro permite la comunicación eficaz entre diferentes GPU para minimizar la latencia y maximizar el rendimiento, tal y como lo demuestran las pruebas NCCL de ancho de banda de punto a punto.

Para obtener toda la información sobre las líneas de sistemas para GPU NVIDIA de Supermicro, visite https://www.supermicro.com/products/nfo/gpu.cfm.